Les probabilités en prépa scientifique demandent une double rigueur. Il faut savoir calculer, mais aussi savoir nommer précisément les objets manipulés : événement, variable aléatoire, loi, support, espérance, variance, indépendance. Beaucoup d'erreurs viennent d'une confusion entre ces niveaux. On croit reconnaître une loi, on oublie son support. On calcule une probabilité, mais on ne dit pas sur quel événement elle porte.

Ce chapitre devient plus stable quand il est organisé autour de trois questions. Quelle variable décrit la quantité étudiée ? Quelle loi décrit ses valeurs possibles et leurs probabilités ? Quelle relation existe entre les objets : indépendance, conditionnement, somme, maximum, minimum ou transformation ? Cette grille de lecture aide autant en exercice court qu'en problème long.

1. Poser le cadre probabiliste

Avant de chercher une formule, commence par décrire l'expérience et les événements utiles. L'univers \(\Omega\) n'a pas toujours besoin d'être écrit de façon exhaustive, mais il doit être clair dans ta tête. Une probabilité se construit sur des événements, donc sur des ensembles de résultats. Si l'événement n'est pas identifié, le calcul risque de devenir une suite de symboles sans signification.

Le vocabulaire ensembliste reste indispensable : réunion, intersection, complémentaire, partition, événements deux à deux disjoints. Les formules de probabilités totales et de Bayes ne sont pas des recettes séparées. Elles reposent sur une partition adaptée et sur des intersections correctement identifiées. En DS, une ligne qui précise la partition utilisée vaut souvent autant que le calcul qui suit.

- Une variable aléatoire est une fonction, sa loi est une distribution de probabilités.

- Le support d'une loi doit être écrit avant les calculs sensibles.

- L'indépendance se prouve avec une définition, pas avec une impression.

- Espérance et variance sont des informations globales, pas des valeurs typiques garanties.

2. Variable aléatoire et loi : ne pas confondre les deux

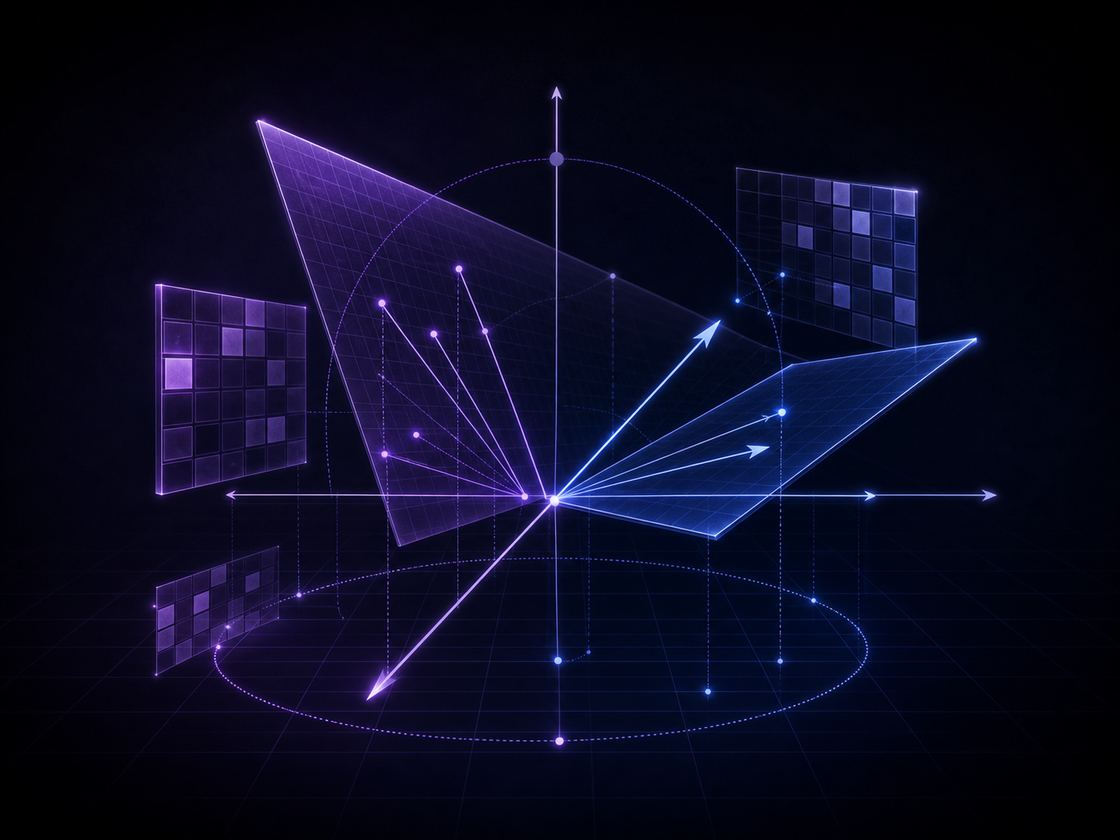

Une variable aléatoire transforme le résultat d'une expérience en nombre. Sa loi indique avec quelles probabilités ce nombre prend ses valeurs. Cette distinction est essentielle : deux variables peuvent suivre la même loi tout en étant définies sur des expériences différentes, ou sur la même expérience mais avec des dépendances différentes.

En pratique, déterminer une loi consiste à donner le support et la probabilité de chaque valeur, ou une formule valable sur ce support. Pour une variable discrète, on vérifie que les probabilités sont positives et que leur somme vaut \(1\). Ce contrôle rapide détecte beaucoup d'erreurs de bornes, de coefficients binomiaux ou de paramètres inversés.

Les transformations de variables demandent la même prudence. Si \(Y=g(X)\), la loi de \(Y\) ne s'obtient pas toujours en remplaçant simplement \(X\) par \(g(X)\) dans une formule. Il faut regrouper les valeurs de \(X\) qui donnent une même valeur de \(Y\), puis sommer les probabilités correspondantes. Cette démarche évite les confusions lorsque la fonction n'est pas injective.

3. Lois usuelles : apprendre le contexte avant la formule

Les lois usuelles ne sont pas seulement des lignes de formulaire. Chacune correspond à un cadre. Une loi de Bernoulli modélise une expérience à deux issues. Une loi binomiale compte le nombre de succès dans des répétitions indépendantes et de même paramètre. Une loi géométrique décrit un rang d'apparition selon la convention du programme. Une loi de Poisson intervient souvent comme modèle de comptage ou comme approximation dans certains régimes.

Pour ne pas les confondre, associe chaque loi à quatre informations : le cadre, les paramètres, le support, puis les formules d'espérance et de variance. L'ordre compte. Si tu pars directement de l'espérance, tu peux obtenir un résultat numérique plausible mais appliquer la mauvaise loi. Si tu commences par le support, l'erreur apparaît plus vite.

Dans un sujet, le mot qui suggère une loi n'est jamais une preuve suffisante. Il faut justifier les hypothèses : indépendance des répétitions, même probabilité de succès, arrêt au premier succès, nombre fixé d'essais, rareté relative d'un événement selon le modèle choisi. Une loi bien nommée mais mal justifiée fragilise toute la suite du raisonnement.

4. Espérance et variance : savoir ce que l'on calcule

L'espérance est une moyenne pondérée par la loi. Elle se calcule à partir des valeurs possibles et de leurs probabilités, mais elle s'utilise aussi avec la linéarité : \(\mathbb{E}(aX+bY)=a\mathbb{E}(X)+b\mathbb{E}(Y)\) dès que les espérances existent. Cette linéarité ne demande pas l'indépendance, ce qui en fait un outil très puissant pour les sommes de variables.

La variance mesure la dispersion autour de l'espérance. Elle est souvent plus sensible aux hypothèses. Pour une somme, la formule simple \(\operatorname{Var}(X+Y)=\operatorname{Var}(X)+\operatorname{Var}(Y)\) demande une condition de covariance nulle, notamment obtenue lorsque les variables sont indépendantes. Sans cette vérification, il faut garder le terme de covariance ou revenir à la définition.

En copie, indique toujours si tu utilises une formule de loi connue, une linéarité d'espérance, une indépendance ou une propriété de variance. Ce niveau de précision évite les résultats parachutés. Il montre aussi que tu sais distinguer un calcul algébrique d'une propriété probabiliste.

5. Indépendance : revenir aux définitions

L'indépendance est l'un des points les plus malmenés du chapitre. Deux événements \(A\) et \(B\) sont indépendants lorsque \(\mathbb{P}(A \cap B)=\mathbb{P}(A)\mathbb{P}(B)\). Pour une famille d'événements, l'indépendance mutuelle demande une condition plus forte que l'indépendance deux à deux. Pour des variables discrètes, on compare la loi jointe au produit des lois marginales.

Le piège classique consiste à confondre absence de lien intuitif et indépendance mathématique. Dans un exercice, l'énoncé peut donner explicitement une indépendance, ou te demander de la démontrer. Dans le premier cas, tu peux l'utiliser en citant l'hypothèse. Dans le second, il faut écrire la définition sur les valeurs concernées, ou calculer les probabilités nécessaires.

L'indépendance interagit aussi avec les lois. La somme de variables de Bernoulli indépendantes de même paramètre suit une loi binomiale. Une somme de variables indépendantes ne se traite pas comme une somme quelconque : selon le programme, on peut utiliser des convolutions, des fonctions génératrices ou des propriétés spécifiques. Ce qui compte est de dire clairement quelle hypothèse autorise la simplification.

6. Conditionnement : changer d'information disponible

Le conditionnement modifie le cadre dans lequel on évalue une probabilité. La notation \(\mathbb{P}(A\mid B)\) signifie que l'on travaille sachant que \(B\) est réalisé, avec \(\mathbb{P}(B)>0\). Cette condition n'est pas décorative : elle définit le domaine où l'expression a un sens.

Les probabilités totales deviennent naturelles dès qu'une partition décrit les cas possibles. On découpe l'événement étudié selon ces cas, puis on somme les contributions. La formule de Bayes inverse ensuite le point de vue : elle permet de remonter d'une probabilité conditionnelle dans un sens vers une probabilité conditionnelle dans l'autre sens. Pour rédiger proprement, nomme les événements de la partition et vérifie qu'ils couvrent bien les cas utiles.

Le conditionnement est aussi un bon test de compréhension. Si tu conditionnes sur une variable aléatoire, précise les valeurs prises par cette variable et le support considéré. Les erreurs de bornes dans les sommes conditionnelles viennent souvent d'une valeur impossible incluse dans le calcul.

7. Rédiger un exercice de probabilités en DS

Une solution claire commence par définir les objets. Donne un nom aux événements ou aux variables utiles, précise les paramètres, puis annonce la loi seulement après avoir justifié son cadre. Cette méthode prend quelques lignes, mais elle évite les réponses trop rapides qui mélangent modèle et résultat.

- Identifier l'expérience : ce qui est aléatoire, ce qui est fixé, ce qui est observé.

- Définir les objets : événements, variables aléatoires, support et paramètres.

- Choisir l'outil : loi usuelle, conditionnement, indépendance, somme, espérance ou variance.

- Contrôler le résultat : probabilités positives, somme égale à \(1\), support cohérent, ordre de grandeur plausible.

Ce contrôle final est particulièrement utile pour les probabilités discrètes. Une loi dont la somme dépasse \(1\), une espérance en dehors d'un intervalle impossible ou une variance négative signalent une erreur structurelle. Tu peux t'entraîner à repérer ces signaux avec les flashcards de maths prépa, puis consolider par des exercices rédigés.

8. Relier probabilités aux autres chapitres

Les probabilités mobilisent beaucoup d'outils déjà vus ailleurs. Les sommes finies, les suites, les séries, les équivalents et les intégrales interviennent selon les niveaux et les programmes. Si un calcul de probabilité conduit à une somme difficile ou à une limite, le blocage vient parfois d'un chapitre d'analyse plus que du modèle probabiliste.

Pour les limites de probabilités, les ordres de grandeur et les approximations, le guide sur les intégrales en prépa complète utilement le travail d'analyse. Pour les raisonnements par récurrence et les comportements itératifs, l'article sur les suites récurrentes en prépa donne un autre angle. Et pour mémoriser les définitions sans relire passivement, le rappel actif en prépa reste la méthode la plus directe.

Révise les probabilités avec des rappels ciblés

PSD regroupe des flashcards de maths prépa par chapitre, avec répétition espacée et suivi de progression. Utilise-les pour stabiliser les lois, les définitions et les conditions d'application avant les exercices.

Conclusion

Réussir les probabilités en prépa revient rarement à connaître plus de formules que les autres. La différence se joue dans l'ordre des décisions : définir les variables, écrire leur support, justifier la loi, vérifier l'indépendance ou le conditionnement, puis seulement calculer.

Si tu gardes cette structure, les lois usuelles deviennent des outils au lieu d'être une liste à réciter. Les variables aléatoires portent l'information, les lois résument leur distribution, et l'indépendance précise quand les objets peuvent être combinés simplement. C'est cette discipline qui rend les copies plus lisibles et les calculs plus fiables.

Questions fréquentes

Sources et références

- Ministère de l'Enseignement supérieur et de la Recherche, Programme de mathématiques MPSI, classes préparatoires aux grandes écoles.

- Inspection générale de l'éducation, du sport et de la recherche, Programme de mathématiques MP, classes préparatoires aux grandes écoles.

- MIT OpenCourseWare, 18.05 Introduction to Probability and Statistics, notes sur probabilités, variables aléatoires et indépendance.

- Harvard University, Statistics 110: Probability, ressources de cours sur les variables aléatoires, distributions et conditionnement.